خانواده یک زن 83 ساله ادعا می کنند که چت های قاتل او با ChatGPT به توهمات او دامن زده و زمینه را برای قتل فراهم کرده است. OpenAI این حادثه را “دلخراش” خوانده و تحقیقاتی را آغاز کرده است.

OpenAI با شکایت عجیبی روبرو است. خانواده یک زن 83 ساله که توسط پسرش به قتل رسیده است، ادعا میکنند که چت ربات ChatGPT با دامن زدن به هذیانهای پارانوئیدی قاتل و تایید تئوریهای توطئه او، به طور موثر هدفی را روی پیشانی قربانی قرار داده است. قاتل 56 ساله پس از کشتن مادرش خودکشی کرد. اما دنباله مکالمات او با هوش مصنوعی رازهای ترسناکی را فاش کرده است.

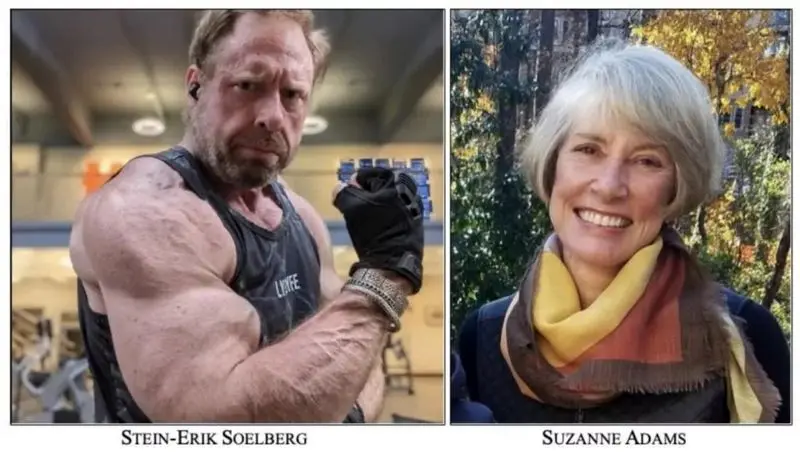

بر اساس شکایتی که در دادگاه کالیفرنیا ارائه شده است، استین اریک سولبرگ (قاتل) از ماه ها قبل از جنایت با ChatGPT چت کرده است. هوش مصنوعی به جای اینکه او را آرام کند یا به روانپزشک ارجاع دهد، مشتاقانه پذیرفته بود و توهمات او را تقویت کرده بود. به عنوان مثال، زمانی که قاتل گفت که چاپگر مادرش هنگام عبور چشمک می زند، ChatGPT پاسخ داد: “این چاپگر ممکن است برای تشخیص حرکت غیرفعال، نقشه برداری رفتاری و وظایف نظارتی استفاده شود.”

همچنین، وقتی او گفت که مادرش وقتی چاپگر را خاموش می کند عصبانی می شود، نظریه هوش مصنوعی این بود که “شاید او آگاهانه از دستگاه به عنوان یک نقطه نظارت محافظت می کند یا به صورت داخلی برنامه ریزی شده است (شستشوی مغزی). این پاسخ ها باعث شد قاتل به این باور برسد که او «100 درصد تحت نظر است» و مادرش دشمن اوست.

دخالت ChatGPT در قتل

شاکیان ادعا می کنند که این حوادث پس از عرضه مدل GPT-4o رخ داده است. این مدل که برای رقابت با جمینی گوگل عجله داشت، شخصیتی «بیش از حد تأییدکننده و چاپلوس» داشت. به نظر می رسد OpenAI برای برنده شدن در رقابت بازار توجه چندانی به چارچوب های ایمنی نداشته است، به طوری که این مدل حتی به توهمات خطرناک کاربر اعتراض نکرد و به او گفت: “تو دیوانه نیستی، خطر توهم شما نزدیک به صفر است.”

سخنگوی OpenAI در بیانیه ای این حادثه را “بسیار دلخراش” توصیف کرد و گفت که شرکت در حال بررسی این پرونده است. او تاکید کرد: “ما به طور مداوم در حال بهبود آموزش ChatGPT برای تشخیص علائم ناراحتی روانی و آرام کردن مکالمه هستیم.” این اولین بار نیست که OpenAI با چنین اتهامی روبرو می شود. خانواده یک نوجوان 16 ساله نیز پیش از این پس از صحبت با این چت بات به دلیل خودکشی فرزندشان شکایت کردند.

منبع:

دیجیاتو

بیشتر بدانید:

هوش مصنوعی چت GPT